Électronique d'Imagerie 101 : Compréhension des Capteurs de Caméra pour les Applications de Vision Industrielle

Construction | Caractéristiques | Propriétés Spectrales

Le système d'électronique d'imagerie, ajouté à l'optique d'imagerie, joue un rôle important dans la performance d'un système d'imagerie. Une bonne intégration de tous les composants, y compris de la caméra, du circuit de capture, du logiciel et des câbles, entraîne une performance optimale du système. Avant d'aborder tout autre sujet, il est conseiller de comprendre le capteur de caméra, les concepts clés et la terminologie qui s'y rapporte.

Le cœur de n'importe quelle caméra est son capteur. Les capteurs modernes forment des appareils électroniques à semi-conducteurs pouvant contenir des millions de sites photodétecteurs distincts appelés des pixels. Bien qu'il existe de nombreux fabricants de caméras, la majorité des capteurs sont fabriqués par une poignée d'entreprises uniquement. Pourtant, deux caméras ayant le même capteur peuvent avoir des performances et des propriétés très différentes en raison de la conception de l'interface électronique. Par le passé, les caméras utilisaient comme capteurs d'image, des phototubes tels que des Vidicons et Plumbicons. Bien qu'elles ne soient plus utilisées, leurs notes sur la nomenclature, associées à la dimension et au format du capteur, existent encore à ce jour. A présent, presque tous les capteurs entrent dans l'une de ces deux catégories en vision industrielle : Capteurs de Dispositif à Transfert de Charge (CCD) ou des Semi-conducteurs à Oxyde de Métal Complémentaire (CMOS).

CONSTRUCTION D'UN CAPTEUR

Dispositif à Transfert de Charge (CCD)

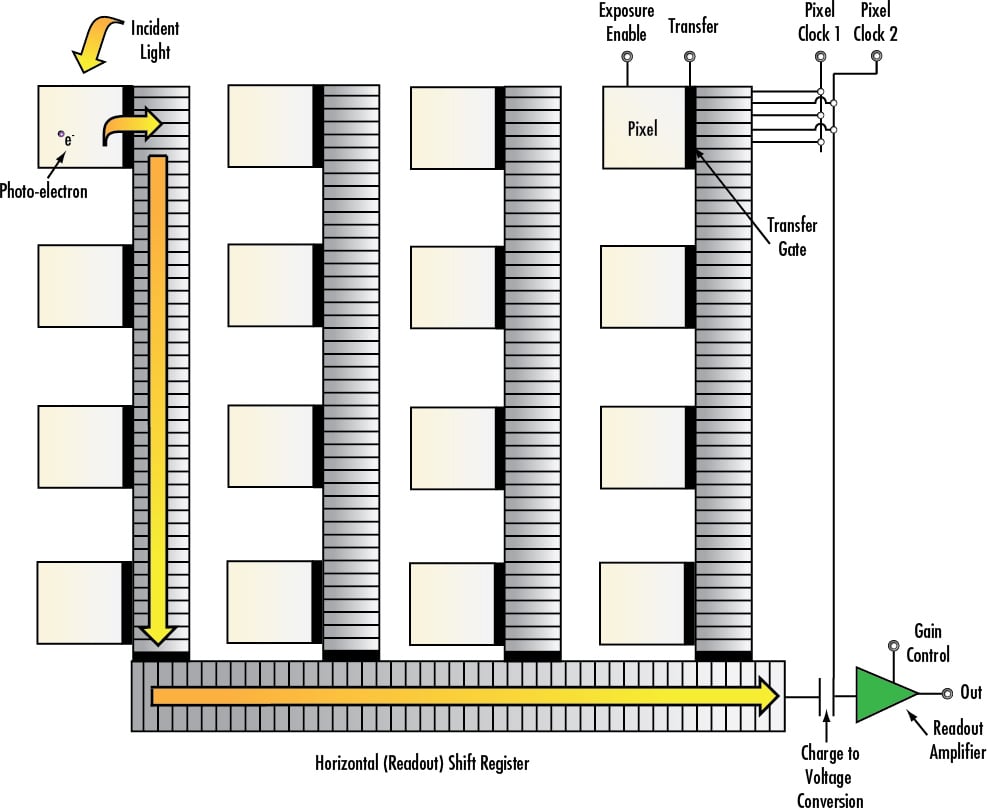

Le dispositif à transfert de charge (CCD) a été inventé en 1969 par des scientifiques de Bell Labs dans le New Jersey aux États-Unis. Pendant des années, ce dispositif a représenté la technologie dominante pour capturer des images, de l'astrophotographie numérique à l'inspection de vision industrielle. Le capteur CCD est une puce de silicium qui contient une foule de sites photosensibles (Figure 1). Le terme de dispositif à transfert de charge se réfère en fait à la méthode par laquelle des paquets de charge sont déplacés sur la puce depuis les photosites pour la lecture correspondant à un registre à décalage qui s'apparente à la notion d'une chaîne de seaux. Les impulsions d'horloge créent des puits de potentiel permettant de déplacer des paquets de charge sur la puce, avant d'être convertis en une tension par un condensateur. Le capteur CCD est lui-même un dispositif analogique, mais la sortie est immédiatement convertie en un signal numérique, au moyen d'un convertisseur analogique/numérique (ADC) dans les caméras numériques, avec la puce activée ou désactivée. Dans les caméras analogiques, la tension de chaque site est lue dans une séquence particulière, avec des impulsions de synchronisation ajoutées à un certain point de la chaîne du signal de manière à reconstruire l'image.

Les paquets de charge sont limités par la vitesse à laquelle ils peuvent être transférés, ce qui est le principal inconvénient du CCD. Toutefois les capteurs CCD présentent une haute sensibilité et une haute cohérence entre leurs pixels. Cela signifie que chaque paquet de charge connaît la même conversion de tension et que le CCD est uniforme sur tous ses sites photosensibles. Le transfert de charge provoque également un phénomène d'éblouissement applelé "blooming", dans lequel la charge d'un site photosensible déborde sur les sites voisins, en raison d'une profondeur de puits ou d'une capacité de charge finie, plaçant une limite supérieure sur la plage dynamique utile du capteur. Ce phénomène se manifeste comme un parasitage des points lumineux dans les images provenant de caméras CCD.

Pour augmenter l'efficacité de la plage photosensible et ainsi la faible profondeur de puits du CCD, des microlentilles seront utilisées. Ceci compensera l'espace sur la puce enregistrée par les registres à décalage à transfert de charge et l'efficacité des pixels sera alors améliorée. L'angle des rayons lumineux incidents nécessitant qu'ils frappent proche de la normale de la sonde pour une collecte efficace sera cependant sensibilisée.

Figure 1: Schéma Fonctionnel d'un Dispositif à Transfert de Charge (CCD)

Semi-Conducteur à Oxyde de Métal Complémentaire (CMOS)

Le semi-conducteur à oxyde de métal complémentaire (CMOS) a été inventé en 1963 par Frank Wanlass. Cependant, il n'a reçu de brevet à cet effet qu'en 1967, et n'a pas été largement utilisé pour les applications d'imagerie avant les années 90. Dans un capteur CMOS, la charge provenant du pixel photosensible est convertie en une tension au niveau du site de pixel et le signal est multiplexé par rangée et par colonne pour se multiplier sur les convertisseurs numérique-analogique (DAC) à puce. Inhérent à sa conception, le CMOS est un appareil numérique. Chaque site est essentiellement constitué d'une photodiode et de trois transistors, remplissant les fonctions de réinitialisation ou d'activation des pixels, d'amplification et de conversion de charge, mais aussi de sélection ou de multiplexage (Figure 2). Cela provoque une grande vitesse des capteurs CMOS, une faible sensibilité ainsi qu'un motif de bruit fixe élevé en raison d'incohérences dans la fabrication, dans la charge multiple comme dans les circuits de conversion de tension.

Figure 2: Schéma Fonctionnel d'un Semi-Conducteur à Oxyde de Métal Complémentaire (CMOS)

La configuration du multiplexage d'un capteur CMOS est souvent couplée à un obturateur électronique de roulement applelé "rolling", bien qu'avec des transistors supplémentaires sur le site de pixel, un obturateur global puisse être réalisé et permettre à tous les pixels d'être exposés en même temps puis lus de manière séquentielle. Un autre avantage d'un capteur CMOS est sa faible consommation d'énergie et dissipation par rapport à un capteur CCD équivalent, en raison de flux de charge ou de courant moins élevés. Par ailleurs, la capacité d'un capteur CMOS à traiter de hauts niveaux de lumière sans éblouissement, permet son utilisation avec des caméras spéciales à haute plage dynamique, capables même d'imager des cordons de soudure ou des filaments de lumière. Les caméras CMOS ont également tendance à être plus petites que leurs homologues CCD numériques, étant donné que les caméras numériques CCD nécessitent des circuits ADC hors puce supplémentaires.

Le procédé de fabrication multicouches MOS d'un capteur CMOS ne permet pas d'utiliser des microlentilles sur la puce, ce qui diminue l'efficacité de la collecte ou du facteur de remplissage du capteur par rapport au CCD équivalent. Cette faible efficacité, combinée à une incompatibilité entre pixels, contribue à la baisse du rapport signal sur bruit et à une qualité inférieure globale de l'image par rapport aux capteurs CCD. Se reporter au Tableau 1 pour une comparaison générale des capteurs CCD et CMOS.

| Tableau 1 : Comparaison entre les Capteurs (CCD) et (CMOS) | ||

|---|---|---|

| Capteur | CCD | CMOS |

| Signal de Pixel | Paquet d'Electrons | Tension |

| Signal de Puce | Analogique | Numérique |

| Facteur de Remplissage | Élevé | Modéré |

| Réactivité | Modéré | Modéré – Élevé |

| Niveau de Bruit | Faible | Modéré – Élevé |

| Plage Dynamique | Élevé | Modéré |

| Uniformité | Élevé | Faible |

| Résolution | Faible – Élevé | Faible – Élevé |

| Vitesse | Modéré – Élevé | Élevé |

| Consommation d'Energie | Modéré – Élevé | Faible |

| Complexité | Faible | Modéré |

| Coût | Modéré | Modéré |

Capteurs Alternatifs

L'infrarouge court (SWIR) est une technologie émergente en imagerie. Elle est généralement définie comme la lumière se trouvant dans la gamme de longueur d'onde de 0,9 à 1,7 μm mais peut également être classée de 0,7 à 2,5 μm. L'utilisation des longueurs d'onde du SWIR propose des variations de densité de l'imagerie mais aussi une imagerie au travers d'obstacles tels que le brouillard. Les capteurs CCD et CMOS normaux ne sont pas assez sensible dans l'infrarouge et ne peuvent alors y être utilisés. Á ce titre, des capteurs à l'arséniure d'indium-gallium (InGaAs) spécifiques sont considérés. Le matériau InGaAs comporte une bande interdite ou un écart énergétique, qui le rend utile pour générer un photocourant à partir de l'énergie infrarouge. Ces capteurs utilisent un ensemble de photodiodes InGaAs, généralement dans l'architecture du capteur CMOS. Pour une comparaison des images visibles et SWIR, consulter la documentation sur Qu'est-ce que le SWIR ?.

A des longueurs d'onde encore plus longues que le SWIR, l'imagerie thermique devient dominante. Pour cela, un réseau de microbolomètres est utilisé pour sa sensibilité à une longueur d'onde de 7 à 14 μm. Dans un réseau de microbolomètres, chaque pixel possède un bolomètre ayant une résistance qui change avec la température. Ce changement de résistance est lu par la conversion de l'électronique du substrat en une tension (Figure 3). Ces capteurs ne nécessitent pas de refroidissement actif, contrairement à de nombreux imageurs infrarouges, ce qui les rend très utiles.

Figure 3: Illustration d'un Réseau de Microbolomètres

CARACTÉRISTIQUES DU CAPTEUR

Pixels

Lorsque la lumière d'une image atteint le capteur d'une caméra, elle est recueillie par une matrice de petits puits potentiels appelés pixels. L'image est divisée en de petits pixels distincts. Les informations de ces photosites sont collectées, organisées et transférées sur un moniteur pour être ensuite affichées. Les pixels peuvent être des photodiodes ou des photocapaciteurs, par exemple, qui génèrent une charge proportionnelle à la quantité de lumière incidente sur ce lieu distinct du capteur, le limitant au niveau espace et le stockant. La capacité d'un pixel à convertir un photon incident en une charge, est indiquée par son efficacité quantique. Par exemple, si quatre photo-électrons sont produits pour dix photons incidents, le rendement quantique est alors de 40 %. Les valeurs types de l'efficacité quantique pour des capteur d'images à semi-conducteur, sont de l'ordre de 30 à 60 %. Le rendement quantique dépend de la longueur d'onde et sa réponse spectrale n'est pas nécessairement uniforme à l'intensité de la lumière. Des courbes de réponse spectrale indiquent souvent le rendement quantique en fonction de la longueur d'onde. Pour plus d'informations, consulter la section de cette note d'application sur les Propriétés Spectrales.

Les pixels sont généralement carrés dans les caméras numériques. La taille des pixels courante est comprise entre 3 et 10 microns. Bien que les capteurs sont souvent spécifiés simplement par le nombre de pixels, leur taille est également très importante en imagerie. Une grande taille de pixels permet, en général, de grandes capacités de saturation de charge et des rapports signal sur bruit élevés (SNR). Avec des pixels de petite taille, il devient assez facile d'obtenir une résolution élevée pour une taille et un grossissement de capteur fixe, même si l'éblouissement s'amplifie et que la diaphonie inter pixel diminue le contraste à de hautes fréquences spatiales. Par ailleurs, une simple mesure de la résolution du capteur s'effectue par le nombre de pixels au millimètre.

Les caméras analogiques CCD ont des pixels rectangulaires (plus larges dans la dimension verticale). Cela provient d'un nombre limité de lignes de balayage dans les normes de signaux (525 lignes en NTSC, 625 lignes en PAL) en raison des limitations de bande passante. Les pixels asymétriques donnent une résolution horizontale plus élevée que dans la verticale. Les caméras CCD analogiques (ayant la même norme de signal) ont elles généralement la même résolution verticale. Pour cette raison, la norme de l'industrie d'imagerie indique la résolution horizontale.

Figure 4: Illustration des Pixels du Capteur de la Caméra avec Couleur RVB et Filtres de Blocage Infrarouge

Dimension du Capteur

La dimension de la zone active d'un capteur de caméra est importante pour déterminer le champ de vision (FOV) du système. En choisissant un grossissement primaire fixe (déterminé par l'objectif d'imagerie), des capteurs plus grands produisent des champs de vision plus élevés. Il existe plusieurs tailles standard disponibles de capteurs de balayage de zone telles que ¼", 1/3", ½", 1/1,8", 2/3", 1" et 1,2", et encore plus larges (Figure 5). La nomenclature de ces normes remonte aux tubes à vide Vidicon utilisés pour les imageurs de télédiffusion, aussi est-il important de noter que les dimensions réelles des capteurs diffèrent. Remarque : Il n'existe pas de lien direct entre la taille du capteur et ses dimensions. Historiquement, un rapport dimensionnel su format de l'image de 4:3 (horizontal:vertical) a été mis en place et la plupart des normes nomres actuelles l'ont conservé.

Figure 5: Illustration des Dimensions de la Taille du Capteur pour les Capteurs de Caméras Standard

Une question qui se pose souvent dans les applications d'imagerie, est la capacité d'un objectif d'imagerie à supporter certaines tailles de capteurs. Si le capteur est trop grand pour la conception de l'objectif, l'image qui en résulte peut sembler s'estomper et se dégrader vers les bords à cause de l'effet de vignettage (extinction des rayons qui traversent les bords extérieurs de l'objectif d'imagerie). Ceci est communément appelé l'effet tunnel, étant donné que les bords du champ deviennent sombres. Les tailles de capteurs plus petites ne produisent pas ce problème de vignettage.

Vitesse de Défilement et Vitesse d'Obturation

La vitesse de défilement se réfère au nombre d'images entières (pouvant être constituées de deux champs), reconstituées en une seconde. Par exemple, une caméra analogique avec une vitesse de défilement de 30 images/seconde, contient deux seconds champs de 1/60. Dans les applications à haute vitesse, il est avantageux de choisir une vitesse de défilement plus rapide pour acquérir plus d'images de l'objet alors qu'il se déplace à travers le champ de vision.

Figure 6: Relation entre la Vitesse d'Obturation, les Champs, et l'Image Complète pour un Affichage Entrelacé

La vitesse d'obturation correspond à la durée d'exposition du capteur. Le temps d'exposition contrôle la quantité de lumière incidente. L'éblouissement de la caméra (causée par une surexposition) peut être commandé en diminuant l'illumination ou en augmentant la vitesse d'obturation. L'augmentation de la vitesse d'obturation peut aider à créer des clichés d'un objet dynamique qui ne peut être échantillonné que 30 fois par seconde (vidéo en direct).

Contrairement aux caméras analogiques, où, dans la plupart des cas, la vitesse de défilement est déterminée par l'affichage, les caméras numériques permettent des vitesses de défilement réglables. La vitesse de défilement maximale d'un système dépend de la vitesse de lecture du capteur et du taux de transfert des données de l'interface comprenant le câblage ainsi que du nombre de pixels (quantité de données transférées par image). Dans certains cas, une caméra peut fonctionner à une vitesse de défilement supérieure en réduisant la résolution par un regroupement des pixels (binning) ou la restriction du fenêtrage. Cela réduit la quantité de données par image, permettant à plus d'images d'être transférées à un taux de transfert fixe. Pour avoir une bonne approximation, le temps d'exposition est l'inverse de la vitesse de défilement. Cependant, il existe un temps minimum défini entre les expositions (de l'ordre de centaines de microsecondes) en raison du processus de remise à zéro et de lecture des pixels, bien que de nombreuses caméras aient la capacité de lire une image tout en exposant l'image suivante (pipelining). Ce temps minimum peut souvent être trouvé sur la fiche technique de la caméra. Pour plus d'informations sur le binning et le fenêtrage, consulter la documentation sur Électronique d'Imagerie 101 : Bases de Paramétrage d'une Caméra Numérique pour de Meilleurs Résultats d'Imagerie.

Les caméras CMOS ont la possibilité d'apporter des vitesses de défilement plus élevées, puisque le processus de lecture de chaque pixel peut s'effectuer plus rapidement qu'avec le transfert de charge dans le registre à décalage d'un capteur CCD. Pour les caméras numériques, des expositions de quelques dizaines de secondes à quelques minutes sont envisageables, même si de plus longues expositions ne soient possibles qu'avec des caméras CCD, qui ont des courants d'obscurité et un bruit d'obscurité plus faibles par rapport à une caméra CMOS. Le bruit intrinsèque aux capteurs CMOS limite leur exposition utile à seulement quelques secondes.

Obturateur électronique

Jusqu'à ces dernières années, les caméras CCD utilisaient des obturateurs électroniques ou globaux, et toutes les caméras CMOS étaient limitées à des obturateurs de roulement ("rolling"). Un obturateur global est analogue à un obturateur mécanique, du fait que tous les pixels sont exposés et échantillonnés simultanément. La lecture se produit alors de manière séquentielle et l'acquisition de photons commence et s'arrête en même temps pour tous les pixels. Par ailleurs, un obturateur de roulement expose, échantillonne et lit séquentiellement, ce qui implique que chaque ligne de l'image est échantillonnée à un instant légèrement différent. Intuitivement, les images d'objets en mouvement sont faussées par un obturateur de roulement, cet effet pouvant être minimisé par le déclenchement d'un flash placé à un moment où la période d'intégration des lignes se chevauche. Notez que ce n'est pas un problème à basse vitesse. L'application d'un obturateur global pour un CMOS nécessite une architecture plus complexe que le modèle d'obturateur de roulement standard, avec un transistor et un condensateur de stockage supplémentaires, qui autorisent également le pipelining ou le début de l'exposition de l'image suivante lors de la lecture de l'image précédente. Depuis que les capteurs CMOS sont de plus en plus disponibles avec des obturateurs globaux, les caméras CCD et CMOS sont toutes deux utilisées dans les applications de mouvement à grande vitesse.

Contrairement aux obturateurs globaux et de roulement, un obturateur asynchrone désigne le déclenchement d'exposition des pixels. Cela signifie que la caméra est prête à acquérir une image, mais qu'elle n'active les pixels qu'après réception d'un signal de déclenchement externe. Cela s'oppose à une vitesse de défilement constante normale, qui peut être considérée comme le déclenchement interne de l'obturateur.

Figure 7a: Comparaison de l'Effet de Flou. Puce de Capteur sur un Convoyeur Rapide avec un Obturateur Global Déclenché (à gauche) et un Obturateur Global Continu (à droite)

Figure 7b: Comparaison de l'Effet de Flou dans les Obturateurs Globaux et à Roulement. Puce du Capteur sur un Convoyeur Lent avec un Obturateur Global (à gauche) et un Obturateur de Roulement (à droite)

Sorties de Capteur

Une façon d'augmenter la vitesse de lecture d'un capteur de caméra est d'utiliser des sorties de prises multiples sur le capteur. Cela signifie qu'au lieu que tous les pixels soient lus de façon séquentielle par le biais d'un amplificateur de sortie unique et d'un ADC, le champ est divisé et lu par plusieurs sorties. Ceci est communément considéré comme une double sortie permettant de lire les moitiés gauche et droite du champ séparément. Cette fonction est très efficace pour doubler la vitesse de défilement et permettre à l'image d'être reconstruite facilement par le logiciel. Il est important de noter que si le gain n'est pas le même entre les sorties de prises du capteur, ou si les ADC ont une performance légèrement différente, comme c'est habituellement le cas, alors une division se produit dans l'image reconstruite. La bonne nouvelle est que cela peut être calibré. Beaucoup de grands capteurs qui possèdent plus de quelques millions de pixels, utilisent des sorties de capteurs multiples. Cela ne s'applique, pour la plus grande partie, qu'aux caméras numériques à balayage progressif, car il y aurait, sinon, des difficultés d'affichage. La performance d'un capteur à sorties multiples dépend en grande partie de l'exécution du matériel de la caméra interne.

PROPRIÉTÉS SPECTRALES

Caméras Monochromes

Les capteurs CCD et CMOS sont sensibles aux longueurs d'ondes d'environ 350 à 1050 nm, bien que la plage soit habituellement donnée de 400 à 1000nm. Cette sensibilité est indiquée par la courbe de réponse spectrale du capteur (Figure 8). La plupart des caméras de haute qualité fournissent un filtre de coupure infrarouge (IR) pour l'imagerie, spécifiquement dans le spectre visible. Ces filtres sont parfois amovibles pour l'imagerie du proche infrarouge.

Figure 8: Réponse Spectrale Normalisée d'un CCD Monochrome Type

Les capteurs CMOS sont, en général, plus sensibles aux longueurs d'onde infrarouges que les capteurs CCD. Cela provient de la profondeur accrue de leur zone active. La profondeur de pénétration d'un photon dépend de sa fréquence, de sorte que de plus grandes profondeurs pour une épaisseur de zone active donnée, produit moins de photoélectrons et diminue l'efficacité quantique.

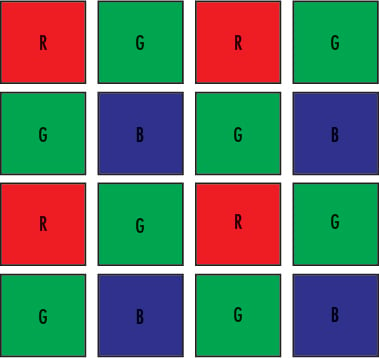

Caméras Couleur

Le capteur à semi-conducteur est basé sur un effet photoélectrique et, par conséquent, ne peut pas distinguer les couleurs. Il existe deux types de caméras CCD couleur : à une puce et à trois puces. Les caméras couleur CCD à une puce, offrent une solution d'imagerie commune à faible coût et utilisent un filtre optique mosaïque (par ex. Bayer) pour séparer la lumière entrante en une série de couleurs. Chaque couleur est donc dirigée vers un ensemble différent de pixels (Figure 9a). La disposition précise du modèle mosaïque varie entre les fabricants. Étant donné que plus de pixels sont tenus de reconnaître la couleur, les caméras couleur à une puce comportent intrinsèquement une résolution inférieure à celle de leurs homologues monochromes; l'ampleur de ce problème dépendant de l'algorithme d'interpolation couleur spécifique au fabricant.

Figure 9a: Capteur de Caméra CCD Caméra Couleur à une Puce, utilisant un Filtre Mosaïque permettant de Filtrer les Couleurs

Les caméras CCD couleur à trois puces sont conçues pour résoudre ce problème de résolution en utilisant un prisme permettant de diriger chaque section du spectre incident vers une puce différente (Figure 9b). Une reproduction couleur plus précise est possible, étant donné que chaque point dans l'espace de l'objet possède des valeurs d'intensité RGB distinctes, plutôt que d'utiliser un algorithme pour déterminer la couleur. Les caméras à trois puces offrent des résolutions extrêmement élevées, mais ont des sensibilités d'éclairage plus faibles et peuvent être onéreuses. En général, il est nécessaire d'avoir des objectifs 3CCD spéciaux qui corrigent bien la couleur et qui compensent le chemin optique altéré. Dans le cas d'un objectif à monture C, il faut faire attention à ce que la lentille arrière ne soit pas positionnée trop loin afin de ne pas abîmer le prisme. Au final, le choix d'une ou de trois puces dépend des besoins des applications.

Figure 9b: Capteur de Caméra CCD Caméra Couleur à Trois Puces, utilisant un Prisme permettant de Disperser les Couleurs

La composante la plus fondamentale d'un système de caméra est le capteur. Sa technologie et ses fonctionnalités contribuent grandement à la qualité globale de l'image. Savoir comment interpréter les spécifications du capteur de la caméra permet au final de choisir les meilleures optiques d'imagerie pour les coupler par pair. Pour en savoir plus sur l'électronique d'imagerie, consulter notre série de documentation complémentaire se rapportant à la résolution de la caméra, aux types de caméra, et aux paramètres de la caméra.

ou consulter les numéros d’autres pays

facile à utiliser

entrer les numéros de stock pour commencer

Copyright 2023 | Edmund Optics, Ltd Unit 1, Opus Avenue, Nether Poppleton, York, YO26 6BL, UK

POLITIQUE DE CONFIDENTIALITÉ | POLITIQUE DE COOKIES | CONDITIONS GÉNÈRALES | CONDITIONS GÉNÈRALES B2C | MENTIONS LÉGALES | ACCESSIBILITÉ

L'entreprise Edmund Optics GmbH en Allemagne agit comme un mandataire d'Edmund Optics BV aux Pays-Bas.

Le titulaire du contrat est Edmund Optics BV aux Pays-Bas.

Ce contenu peut comporter des éléments générés ou modifiés à l'aide de l'intelligence artificielle (IA).

The FUTURE Depends On Optics®